照亮人工智能的黑匣子

来自日内瓦大学 (UNIGE)、日内瓦大学医院 (HUG) 和新加坡国立大学 (NUS) 的研究人员开发了一种评估人工智能 (AI) 技术可解释性的新方法,为提高人工智能驱动的诊断和预测工具的透明度和信任打开了大门。这种创新方法揭示了所谓的“黑匣子”人工智能算法的不透明工作原理,帮助用户了解影响人工智能产生的结果以及结果是否可以信任。

这在对人们的健康和生活产生重大影响的情况下尤其重要,例如在医疗应用中使用人工智能。这项研究在即将出台的《欧盟人工智能法案》的背景下具有特别的相关性,该法案旨在规范欧盟内部人工智能的开发和使用。研究结果最近发表在《自然机器智能》杂志上。

时间序列数据(代表信息随时间的变化)无处不在:例如在医学中,当用心电图(ECG)记录心脏活动时;在地震研究中;跟踪天气模式;或在经济学中监控金融市场。这些数据可以通过人工智能技术建模,以构建诊断或预测工具。

特别是人工智能和深度学习的进步——包括使用这些非常大量的数据来训练机器,目的是解释它并学习有用的模式——为越来越准确的诊断和预测工具开辟了道路。然而,由于没有深入了解Al算法的工作原理或影响其结果的因素,人工智能技术的“黑匣子”性质提出了关于可信度的重要问题。

“至少可以说,这些算法的工作方式是不透明的,”UNIGE医学院放射学和医学信息学系主任兼HUG医学信息科学部主任Christian Lovis教授说,他共同指导了这项工作。“当然,风险,尤其是财务风险,非常高。但是,如果不了解机器推理的基础,我们怎么能信任它呢?这些问题至关重要,尤其是在医学等领域,人工智能驱动的决策可以影响人们的健康甚至生活;和金融,它们可能导致巨大的资本损失。

可解释性方法旨在通过破译人工智能为什么以及如何做出给定的决定以及背后的原因来回答这些问题。“知道在特定情况下哪些因素有利于或反对解决方案,从而允许一些透明度,增加可以对它们的信任,”新加坡国立大学设计与工程学院MathEXLab主任助理教授Gianmarco Mengaldo说。

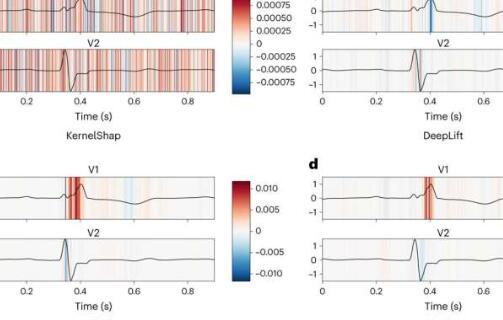

“然而,当前广泛用于实际应用和工业工作流程的可解释性方法在应用于同一任务时提供了明显不同的结果。这就提出了一个重要的问题:鉴于应该有一个独特的正确答案,哪种可解释性方法是正确的?因此,对可解释性方法的评估变得与可解释性本身一样重要。

区分重要与不重要

区分数据对于开发可解释的人工智能技术至关重要。例如,当AI分析图像时,它会专注于一些特征属性。Lovis教授实验室的博士生和该研究的第一作者Hugues Turbé解释说:“例如,人工智能可以区分狗的图像和猫的图像。同样的原则也适用于分析时间序列:机器需要能够选择元素 - 例如比其他峰值更明显的峰值 - 作为其推理的基础。对于ECG信号,这意味着调和来自不同电极的信号,以评估可能的不和谐,这可能是特定心脏病的征兆。

在可用于特定目的的所有可解释性方法中选择一种可解释性方法并不容易。不同的AI可解释性方法通常会产生非常不同的结果,即使应用于相同的数据集和任务也是如此。为了应对这一挑战,研究人员开发了两种新的评估方法来帮助理解人工智能如何做出决策:一种用于识别信号中最相关的部分,另一种用于评估它们相对于最终预测的相对重要性。

为了评估可解释性,他们隐藏了一部分数据,以验证它是否与人工智能的决策相关。但是,这种方法有时会导致结果错误。为了纠正这一点,他们在增强现实数据集上训练了人工智能,其中包括有助于保持数据平衡和准确的隐藏数据。然后,该团队创建了两种方法来衡量可解释性方法的效果,显示AI是否使用正确的数据来做出决策,以及是否所有数据都得到了公平的考虑。

“总体而言,我们的方法旨在评估将在其操作领域实际使用的模型,从而确保其可靠性,”Turbé解释道。

为了进一步研究,该团队开发了一个合成数据集,并将其提供给科学界,以轻松评估任何旨在解释时间序列的新人工智能。

展望未来,该团队现在计划在临床环境中测试他们的方法,对人工智能的担忧仍然普遍存在。“建立对AI评估的信心是将其在临床环境中采用的关键一步,”Lovis教授部门机器学习团队负责人Mina Bjelogrlic博士解释说,他是这项研究的第二作者。“我们的研究侧重于基于时间序列的AI评估,但相同的方法可以应用于基于医学中使用的其他模式(如图像或文本)的AI。

免责声明:本文由用户上传,与本网站立场无关。财经信息仅供读者参考,并不构成投资建议。投资者据此操作,风险自担。 如有侵权请联系删除!

-

【既简单又好吃的甜品】在快节奏的生活中,很多人想要享受甜品的乐趣,但又担心制作过程复杂、耗时太长。其实...浏览全文>>

-

【既简单又好吃的菜包饭】菜包饭是一道非常受欢迎的家常美食,尤其在亚洲地区广为流传。它不仅制作简单,而且...浏览全文>>

-

【既灬也灬二年级造句】在小学语文学习中,“既……也……”是一个常见的句式,用来表达两个并列的情况或特点...浏览全文>>

-

【既好看又好听的网名】在当今网络社交日益频繁的时代,一个好听又好看的网名不仅能够提升个人形象,还能让人...浏览全文>>

-

【既搞笑又土气的名字有什么】在日常生活中,我们经常会遇到一些让人忍俊不禁、又觉得“土味十足”的名字。这...浏览全文>>

-

【既定是什么意思】2、直接用原标题“既定是什么意思”生成一篇原创的优质内容(加表格形式)在日常生活中,我...浏览全文>>

-

【既的意思是什么】2、直接用原标题“既的意思是什么”生成一篇原创的优质内容,要求:以加表格的形式展示答案...浏览全文>>

-

【既的文言文意思】在文言文中,“既”是一个常见的虚词,具有多种含义和用法,常用于表示时间、状态或结果。...浏览全文>>

-

【既戴帽子又戴眼镜的动漫角色】在众多动漫作品中,一些角色因为独特的造型设计而给人留下深刻印象。其中,“...浏览全文>>

-

【既不缺钱也不缺人的山东】山东省作为中国重要的经济大省,一直以来在经济发展、人口规模和资源储备方面都具...浏览全文>>